日期:2025-10-24

版本:0.9.0

日期:2025-08-10

版本:0.11.3

日期:2025-07-08

版本:0.9.5

Ollama官方正版是一款非常实用的大型语言模型本地化运行软件,软件采用的是轻量级框架,不会占用太多的资源,支持多种大型语言模型的本地推理平台,适用于多种应用场景,支持ONNX、PyTorch、TensorFlow等多种流行的模型格式,拥有活跃的开发者社区,提供了丰富的文档和教程,帮助用户解决遇到的各种问题,感兴趣的小伙伴赶快下载使用吧!

1、简化部署:

Ollama 目标在于简化在 Docker 容器中部署大型语言模型的过程,使得非专业用户也能方便地管理和运行这些复杂的模型。

2、轻量级与可扩展:

作为轻量级框架,Ollama 保持了较小的资源占用,同时具备良好的可扩展性,允许用户根据需要调整配置以适应不同规模的项目和硬件条件。

3、API支持:

提供了一个简洁的 API,使得开发者能够轻松创建、运行和管理大型语言模型实例,降低了与模型交互的技术门槛。

4、预构建模型库:

包含一系列预先训练好的大型语言模型,用户可以直接选用这些模型应用于自己的应用程序,无需从头训练或自行寻找模型源。

5、模型导入与定制:

从 GGUF 导入:支持从特定平台(如GGUF,假设这是一个模型托管平台)导入已有的大型语言模型。

从 PyTorch 或 Safetensors 导入:兼容这两种深度学习框架,允许用户将基于这些框架训练的模型集成到 Ollama 中。

自定义提示:允许用户为模型添加或修改提示(prompt engineering),以引导模型生成特定类型或风格的文本输出。

6、跨平台支持:

提供针对 macOS、Windows(预览版)、Linux 以及 Docker 的安装指南,确保用户能在多种操作系统环境下顺利部署和使用 Ollama。

7、命令行工具与环境变量:

命令行启动:通过命令 ollamaserve 或其别名 serve、start 可以启动 Ollama 服务。

环境变量配置:如 OLLAMA_HOST,用于指定服务绑定的主机地址和端口,默认值为 127.0.0.1:11434,用户可以根据需要进行修改。

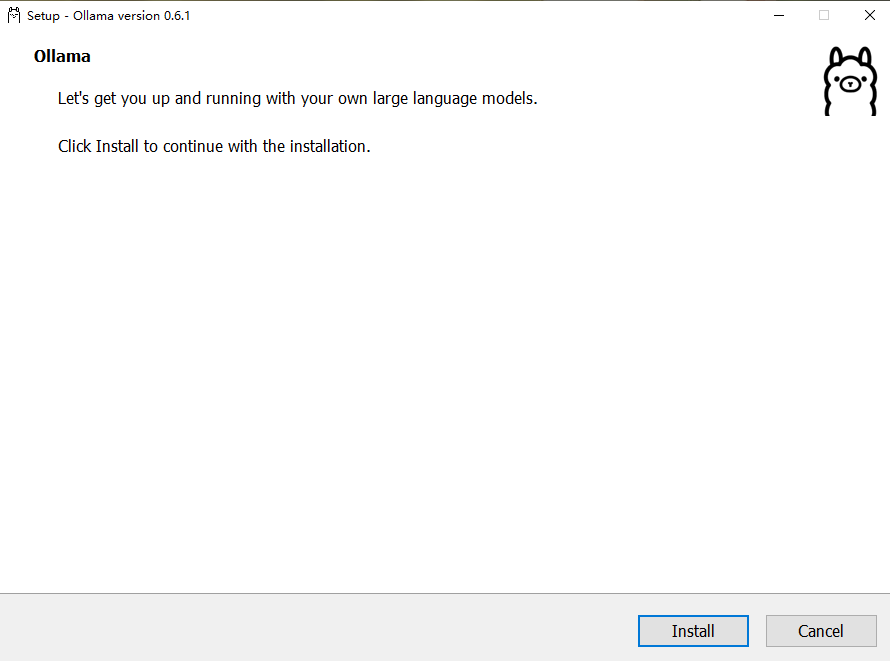

1、双击安装包,点击下一步;

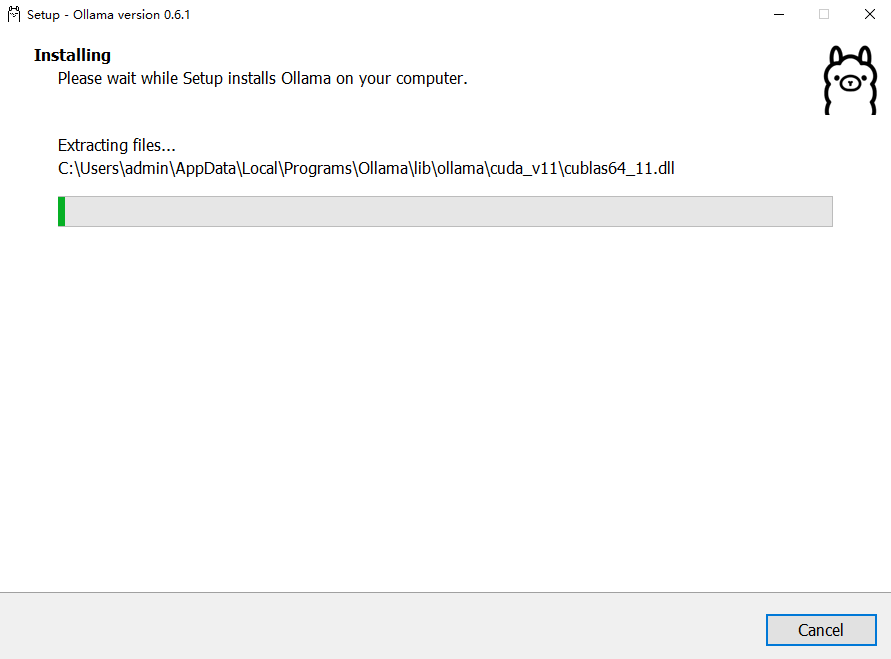

2、点击安装后出现安装进度;等待安装完成。

修复已知Bug,优化客户端对新系统兼容性

日期:2025-10-24

版本:0.9.0

日期:2025-08-10

版本:0.11.3

日期:2025-07-08

版本:0.9.5

ds大模型安装助手官网版

下载

八宝模型库插件旧版本

下载

Mockup Creator(程序模型设计工具) 3.4

下载

FinalMesh(三维模型查看器)v3.2.1.525

下载

《SmartPDF》中文版

下载

HelpNDocv4.0.3.164

下载

《卡脆网络收音机》官方版

下载

技嘉USB注入工具旧版本

下载11.27MB

2025-11-21

25.12MB

2025-11-21

55.78MB

2025-11-21

88.46MB

2025-11-21

3.73MB

2025-11-21

7.24MB

2025-11-21

84.55MB / 2025-09-30

248.80MB / 2025-07-09

2.79MB / 2025-10-16

63.90MB / 2025-11-06

1.90MB / 2025-09-07

210.99MB / 2025-06-09

374.16MB / 2025-10-26

京ICP备14006952号-1 京B2-20201630 京网文(2019)3652-335号 沪公网安备 31011202006753号违法和不良信息举报/未成年人举报:[email protected]

CopyRight©2003-2018 违法和不良信息举报(021-54473036) All Right Reserved

玩家点评 (0人参与,0条评论)

热门评论

全部评论